[!NOTE] 本稿は査読前のプレプリント(arXiv)に基づいています。

1. これは何の話?

LLMベースのエージェントに長期記憶を持たせる手法を検討する開発者・研究者向けに、新しいメモリアーキテクチャ「Hindsight」を提案した研究です。

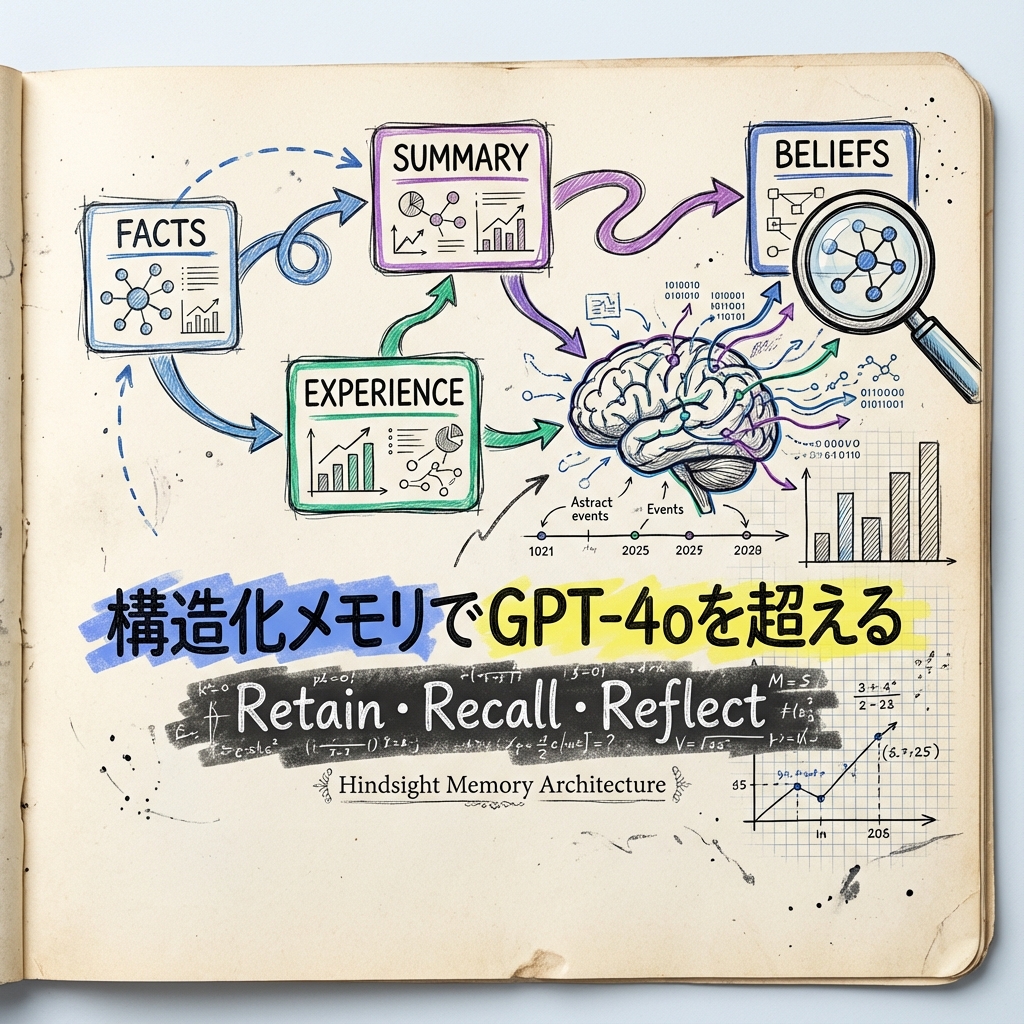

会話ストリーム → 4つの論理ネットワーク → 構造化メモリバンク → 推論+更新

現行のエージェントメモリシステムは会話から断片を抽出してベクトルストアに保存し、top-k検索でプロンプトに挿入する外部レイヤーとして機能しています。しかし証拠と推論の區別が曖昧で、長期間にわたる情報整理が困難という課題がありました。

2. 何がわかったか

Hindsightは4つの論理ネットワークでメモリを構造化します:

- 世界事実:外部の客観的情報

- エージェント経験:エージェント自身の行動履歴

- エンティティ要約:人物・組織などの合成サマリー

- 信念:時間とともに更新される推論結果

20Bオープンソースモデルを使用した評価で、LongMemEvalベンチマークでは39%(フルコンテキストベースライン)から83.6%へ、さらにスケールアップで91.4%を達成。LoCoMoでも89.61%と、従来最強のオープンシステム(75.78%)を大幅に上回りました。

3. 他とどう違うのか

従来のベクトル検索ベースのメモリは「なんでも入れてtop-k取り出し」という単純な仕組みでした。Hindsightは証拠と推論を明確に分離し、反映(Reflect)操作でメモリを追跡可能な形で更新します。

これにより「なぜその回答に至ったか」を説明できるエージェントの構築が可能になります。

4. なぜこれが重要か

エージェントAIが実務で使われるためには、単発の質問応答を超えてセッションをまたいで経験を蓄積し適応する能力が必要です。Hindsightはこの課題に構造的な解決策を提示しており、エンタープライズ向けエージェント開発の設計指針として注目されます。

5. 未来の展開・戦略性

エージェントプラットフォームを開発する企業は、単純なベクトル検索を超えたメモリアーキテクチャの採用を迫られる可能性があります。Hindsightの論理ネットワーク構造はモジュール化されており、既存システムへの段階的導入も可能と考えられます。

6. どう考え、どう動くか

長期記憶を必要とするエージェントを開発中のチームは、Hindsightのアーキテクチャを参考に自社実装の設計を見直す価値があります。

指針:

- 現行のベクトル検索ベースメモリの限界を洗い出す。

- 4つの論理ネットワーク(事実・経験・要約・信念)という分類が自社ユースケースに合うか検討する。

- オープンソースモデルで同等の精度が出るか、自社データで検証する。

次の一歩:

- 今日やること:arXivで本論文を読み、アーキテクチャ図を把握する。

- 今週やること:現行システムのメモリ設計との差分を整理し、改善ポイントを特定する。

7. 限界と未確定

- 評価はLongMemEval・LoCoMoという特定ベンチマークに限定されている。

- 実際のビジネスユースケースでの有効性は追加検証が必要。

- 20Bモデル以下でのパフォーマンスは未報告。

8. 用語ミニ解説

- 情報をどう追加し(Retain)、どうアクセスし(Recall)、どう更新するか(Reflect)を定義した3つの基本操作。(Retain-Recall-Reflect)

9. 出典と日付

arXiv(公開日:2025-12-12):https://arxiv.org/abs/2512.12818

補足メモ

エージェントメモリ「Hindsight」で長期記憶を構造化、GPT-4oを超える精度を達成は、単発のニュースとして消費するだけでなく、前提条件と適用範囲を明確にしながら読むことで実務に転用しやすくなります。LLMエージェントのメモリ機構「Hindsight」は保持・想起・反映の3操作で会話ストリームを構造化されたメモリバンクに変換。20Bオープンソースモデルで91.4%、GPT-4oを超える精度を達成。という観点を中心に、何が確定情報で何が解釈なのかを切り分けて整理することが重要です。

実際の運用では、関係者が同じ判断基準を持てるように、対象業務・期待効果・制約条件を短く言語化しておくと再現性が高まります。必要に応じて一次情報(https://arxiv.org/abs/2512.12818)へ戻り、数値と日付の一致確認を定期的に行うと、認識ずれの拡大を防げます。